|

PT KONTAK PERKASA FUTURES - Sebagai salah satu kunci IT Transformation, membuat data center menjadi lebih modern, lebih canggih, merupakan salah satu kunci perusahaan agar tetap bisa kompetitif di era saat ini. Hal itu membuat kebutuhan akan perangkat canggih yang menjadi dasar data center modern terus meningkat, makin beragam, dan tuntutan untuk siap menghadapi tantangan yang akan datang pun juga harus diperhatikan. Oleh karena itu, sebagai perusahaan ternama di bidang tersebut, Dell EMC, salah satu bagian dari Dell Technologies, memperkenalkan solusi baru mereka untuk memenuhi kebutuhan tersebut.

Lebih Modern, Fokus di Performa dan Efisiensi PT KONTAK PERKASA FUTURES - Dell EMC mencoba membangun storage enterprise class yang siap untuk tantangan yang akan datang, dengan basis end-to-end NVMe yang membuatnya disebut sebagai storage array terkencang di dunia. Produk tersebut mereka sebut sebagai PowerMax, dan disebut bisa menawarkan performa sekitar 2x lipat dari yang ditawarkan pesaing mereka. Hal itu bisa dicapai karena storage ini memanfaatkan NVMe-over-fabrics dan mendukung penuh Storace Class Memory (SCM), seperti Intel 3D XPoint. PT KONTAK PERKASA FUTURES - Selain mengusung teknologi yang membuat PowerMax menawarkan performa tinggi, Dell EMC juga melengkapi storage baru ini dengan teknologi yang membuatnya bisa bekerja dengan efisien. Mereka menghadirkan machine learning untuk memaksimalkan penggunaan SCM, memanfaatkan kemampuan analisis dan pengenalan pola, yang memastikan data disimpan di media yang paling tepat. Selain itu, PowerMax juga menawarkan fitur deduplication dan compression tingkat lanjut untuk efisiensi ruang penyimpanan data, hingga rasio 5:1, serta tetap hadir dengan fitur perlindungan dan keamanan data tingkat tinggi. Siapkan Infrastruktur Modular Future Proof Bukan hanya dari sisi storage, Dell EMC juga melihat bahwa infrastruktur pendukung di data center juga harus bisa beradaptasi dengan kebutuhan yang ada dan yang akan datang. Mereka menyebutkan bahwa mereka kini tengah menggarap sebuah solusi modular untuk infrastruktur data center, yang mereka sebut sebagai PowerEdge MX. Solusi ini disebut akan siap mendekati akhir tahun ini dan akan menawarkan fleksibilitas luar biasa untuk data center, salah satunya dalam hal virtualisasi dan analisis untuk big data. Solusi AI yang Lebih Modern di Data Center Melanjutkan tawaran mereka untuk data center modern yang membuat perusahaan lebih kompetitif, Dell EMD juga menawarkan server terbaru mereka, bagian dari keluarga PowerEdge 14th Generation. Dua server baru tersebut dibekali dukungan untuk AI pendukung analisis data berbasis machine learning. PowerEdge R840 dan PowerEdge R940xa, kedua server baru itu, memiliki empat soket prosesor yang mendukung prosesor Intel Xeon Scalable hingga 112 core dan RAM hingga 6 TB. PowerEdge R840 disebut Dell EMC mendukung akselerasi analisis in-database yang memungkinkan informasi yang dibutuhkan diperoleh dengan lebih cepat, memanfaatkan direct-attached NVMe. Sementara PowerEdge R940xa hadir dengan dukungan empat GPU untuk akselerasi performa untuk mendukung aplikasi business-critical yang akan membantu pengelolaan informasi menjadi keputusan. Menariknya, Dell EMC juga menyertakan dukungan untuk penggunaan FPGA sebagai pengganti GPU untuk pengolahan data yang intensif, yang akan menghadirkan keunggulan tersendiri. Source : jagatreview.com

0 Comments

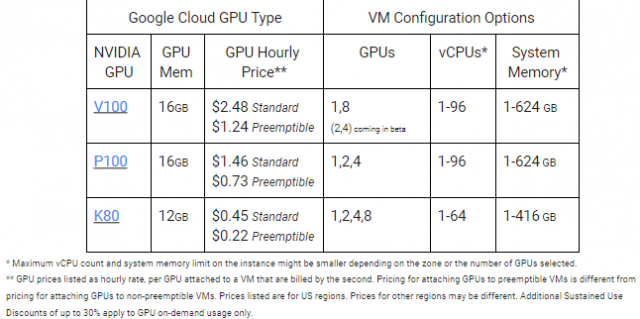

KONTAK PERKASA FUTURES - With recent news that Google’s Cloud TPU is more cost efficient than Nvidia’s Volta, you might think Google would be gearing up to replace competitor GPUs with its own hardware. Instead, the company is extending its GPU offerings to Nvidia’s Volta and deploying the GPU across a wider range of engines. More than anything, this speaks to the wide range of support for various types of machine learning, AI workloads, and general compute performance now available through cloud services. KONTAK PERKASA FUTURES - According to Google’s latest blog post, Nvidia V100 Tesla GPUs are now available for both the Compute Engine and Kubernetes Engines. Kupernetes is typically used to scale containerized applications across the cloud, while Google’s Compute Engine is the cloud of servers that are used to run workloads that can be offloaded for processing and computation. And now, courtesy of this latest upgrade, you can stack eight Tesla V100 GPUs, 96vCPUs (Google’s term for a virtualized CPU core), and 624GB of memory in a single VM, which tends to be a bit more horsepower than your typical individual server can muster. Next-generation NVLink offers up to 300GB/s of GPU-to-GPU bandwidth, and the benefits apparently scale well — Google claims this boosts performance in deep learning and HPC workloads by up to 40 percent. KONTAK PERKASA FUTURES - Google writes that “NVIDIA V100s are available immediately in the following regions: us-west1, us-central1 and europe-west4. Each V100 GPU is priced as low as $2.48 per hour for on-demand VMs and $1.24 per hour for Preemptible VMs. Like our other GPUs, the V100 is also billed by the second and Sustained Use Discounts apply.” The company also gives a bit of light workload guidance. It recommends Nvidia’s P100 GPUs, which are based on Pascal, for workloads that need a balance between price and performance, while K80 (Kepler) GPUs are still available as well for even less-demanding workloads. This chart indirectly highlights why cloud computing can make financial sense for both companies and users. In consumer parlance, K80 is ancient. It’s a dual-GPU part with 2,496 cores and 2x 12GB of GDDR5. It’s thoroughly outclassed and outperformed by GPUs like the V100 — but it’s also available for as little as 45 cents per hour. If you were comparing that kind of hourly rate with the cost of buying an entire server when K80 was new, you’d obviously save a huge amount of money by only tapping the cloud for the workloads you need to process.

Based on the price we’re seeing for basic servers and K80 itself, the break-even point between the cost of a new K80 and using Google’s Compute Engine is around 10,000 hours. So if you think you’re going to need the equivalent of 416 days of GPU time to process a workload, it might be better to just buy the card. And Nvidia, of course, doesn’t really care about the difference between selling a card to a research institution that’ll deploy it in its own servers, and selling one to Google or Amazon or Microsoft to integrate as part of a cloud server offering. Nvidia just wants to sell the card. Interestingly enough, there’s a hint on the same page that Google might soon extend its cloud offerings to encompass cheaper cards. One reader, Seth Price, writes: “I don’t need a top-shelf GPU for the work I do; I only need cheap FLOPS/$. Will we ever see consumer-level GPUs offered on GCP that are worth less than $1,000 each… I’m just looking for fast, efficient, GPU processing at a low cost. I don’t need them to be the best CUDA boxes available. I don’t need scientific-level double floating point precision. I don’t need ridiculous amounts of VRAM. It’s not cost effective for me to pay 100x more per hour for a GPU instance than a CPU instance and I really don’t want to have to build my own boxes. Will GCP ever be able to fill these requirements?” To which, Adrian Graham, Cloud Solutions Architect at Google, replied, “We hear you. Stay tuned for updates.” Source : extremetech.com |

AuthorKontak Perkasa Bandung Archives

February 2022

|